La normalizzazione audio

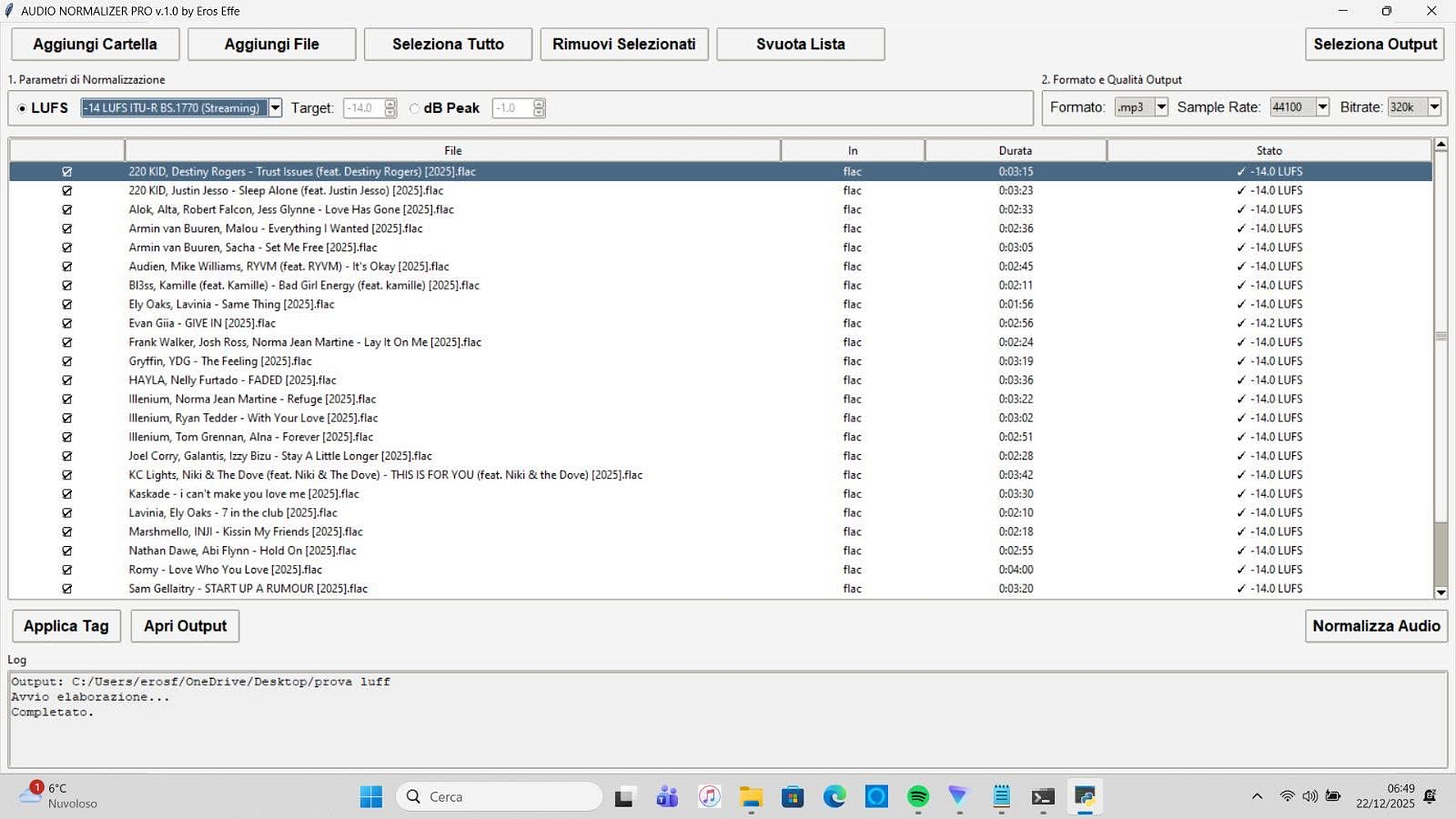

La normalizzazione dell’archivio audio prima del processore.

È una prassi che vedo spesso in giro per il mondo: normalizzare l’archivio audio prima di fare l’ingest.

Attenzione: non il livello di picco, bensì di Loudness!

Eh già…

Le principali emittenti radio non normalizzano i files a livello di picco in dB o dBfs, ma il livello di Loudness, misurato in LUFS.

Fare riferimento alla normalizzazione del picco audio è ormai cosa obsoleta.

E il processore audio alla fine della catena lavora molto meglio.

Ma del resto le raccomandazioni EBU ITU parlano chiaro*

Vediamo bene perché normalizzare in LUFS (e non in dBFS) prima del processore audio è meglio, direi fondamentale!

Il problema è semplice: il picco non descrive l’energia percepita di un segnale quindi non basta.

Un file può avere:

• lo stesso picco

• ma una densità sonora completamente diversa

Un brano molto compresso e uno molto dinamico possono entrambi toccare \(-1\) dBFS, ma il primo “spingerà” un processore molto più del secondo.

In pratica, il picco non rappresenta la realtà sonora che il processore deve gestire.

La loudness in LUFS misura l’energia percepita nel tempo, non solo l’ampiezza istantanea. Questo significa che:

• due segnali normalizzati allo stesso LUFS arrivano al processore con la stessa “forza percepita”; ottimo soprattutto per i processori ‘Old school’ senza riparazioni dell’audio in input (undo, declipper… e così spieghiamo una volta per tutte anche perché ‘de-masterizzare’ o ‘de-comprimere’ prima di ‘ri-processare’ aiuta il processore a lavorare meglio a chi non l’avesse ancora capito o finga di non capirlo)

• la catena di processing lavora in modo coerente, ripetibile e controllabile

• la risposta dei plug‑in diventa prevedibile, indipendentemente dalla dinamica originale del materiale

È esattamente ciò che serve in broadcast, podcasting, radio imaging, mastering e in qualsiasi contesto dove la consistenza è un valore.

Normalizzare in LUFS non è una moda: è un modo per riportare la catena audio sotto controllo.

Vuol dire:

• coerenza

• prevedibilità

• qualità costante

• workflow più veloce

Esempio: poi puoi lasciare i cursori fissi perché tanto l’intensità sonora di brano in brano o brano e station imaging sarà la stessa.

E ora è più chiaro perché il mio amico Luca Viscardi quando era direttore a rtl cazziava I fonici perché un file era alto, uno basso, pur vedendo il picco di Master Control a -1dB!

Semplice… differenza di Master, differenza di LUFS 🙂

Normalizza allo standard ITU, e ti cambia la vita: provare per credere!

So che molti (soprattutto non italiani) diranno “eh hai scoperto l’acqua calda”, ma la percentuale di chi lo fa in Italia è ancora molto bassa.

PS.: volutamente raccontato terra-terra per evitare di annoiare con tecnicismi.

Per chi più avvezzo ad approfondire, ecco le raccomandazioni EBU/ITU:

*EBU R128 S3 https://tech.ebu.ch/publications/r128s3 per la catena di produzione raccomandata a -23 LUFS in radio

Mentre per lo streaming, che non è l’argomento del post, è la S2 https://tech.ebu.ch/publications/r128s2

per le serie tv e il cinema (S4) https://tech.ebu.ch/publications/r128s4

e S1 per gli spot https://tech.ebu.ch/publications/r128s1